728x90

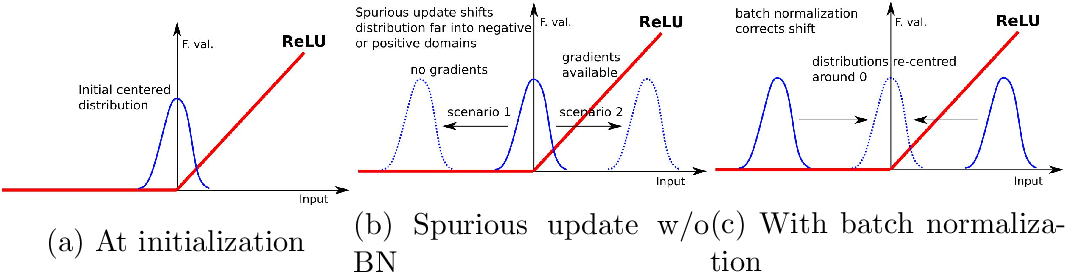

신경망에는 과적합과 Gradient Vanishing 외에 Internal Covariance shift 문제가 또 있다. Internal Covariance shift는 각 Layer마다 Input 분포가 달라짐에 따라 학습 속도가 느려지는 형상이다. Batch Normalization은 이런 것을 해결하기 위해 Input 분포를 정규화 시켜 학습 속도를 빠르게 진행 시킨다.

$BN(h;\gamma,\beta) = \beta + \gamma\tfrac{h-E(h)}{\sqrt{(Var(h)+\epsilon)}}$

반응형

'👾 Deep Learning' 카테고리의 다른 글

| Softmax RuntimeWarning 해결 (0) | 2021.03.03 |

|---|---|

| 활성화 함수(activation function) (0) | 2021.03.03 |

| GAN (Generative Adversarial Networks) (0) | 2021.02.26 |

| 역전파 (backpropagtion) (0) | 2021.02.26 |

| 파이썬의 뉴런 (0) | 2021.02.24 |