https://vcai.mpi-inf.mpg.de/projects/DragGAN/

Drag Your GAN: Interactive Point-based Manipulation on the Generative Image Manifold

--> Abstract Synthesizing visual content that meets users' needs often requires flexible and precise controllability of the pose, shape, expression, and layout of the generated objects. Existing approaches gain controllability of generative adversarial net

vcai.mpi-inf.mpg.de

Abstract

GAN (Generative Adversarial Networks)과 같은 딥 생성 모델들은 무작위로 실사적인 이미지를 합성하는 데에 있어서 전례 없는 성공을 거두었습니다. 실제 응용 프로그램에서 이러한 학습 기반 이미지 합성 방법의 중요한 요구 사항은 생성된 시각적 콘텐츠에 대한 제어 가능성입니다. 예를 들어, 소셜 미디어 사용자는 캡처된 사진에서 인물 또는 동물의 위치, 모양, 표정, 몸의 자세를 조정하고 싶을 수 있습니다. 전문적인 영화 시각화 및 미디어 편집에서는 특정 레이아웃을 가진 장면의 스케치를 효율적으로 생성해야 할 수 있으며, 자동차 디자이너는 자신들의 창작물의 모양을 대화식으로 수정하고 싶어할 수도 있습니다. 이러한 다양한 사용자 요구에 만족시키기 위해서는 이상적인 제어 가능한 이미지 합성 방법은 다음과 같은 특성을 가져야 합니다.

1) 유연성: 생성된 객체 또는 동물의 위치, 자세, 모양, 표정 및 레이아웃과 같은 다양한 공간 속성을 제어할 수 있어야 합니다.

2) 정확성: 공간 속성을 높은 정확도로 제어할 수 있어야 합니다.

3) 일반성: 특정 범주에 국한되지 않고 다른 객체 범주에도 적용할 수 있어야 합니다.

이전 작업들은 이러한 특성 중 하나 또는 두 가지만을 만족시키기 때문에, 이 논문에서는 이러한 특성을 모두 만족시키기를 목표로 합니다.

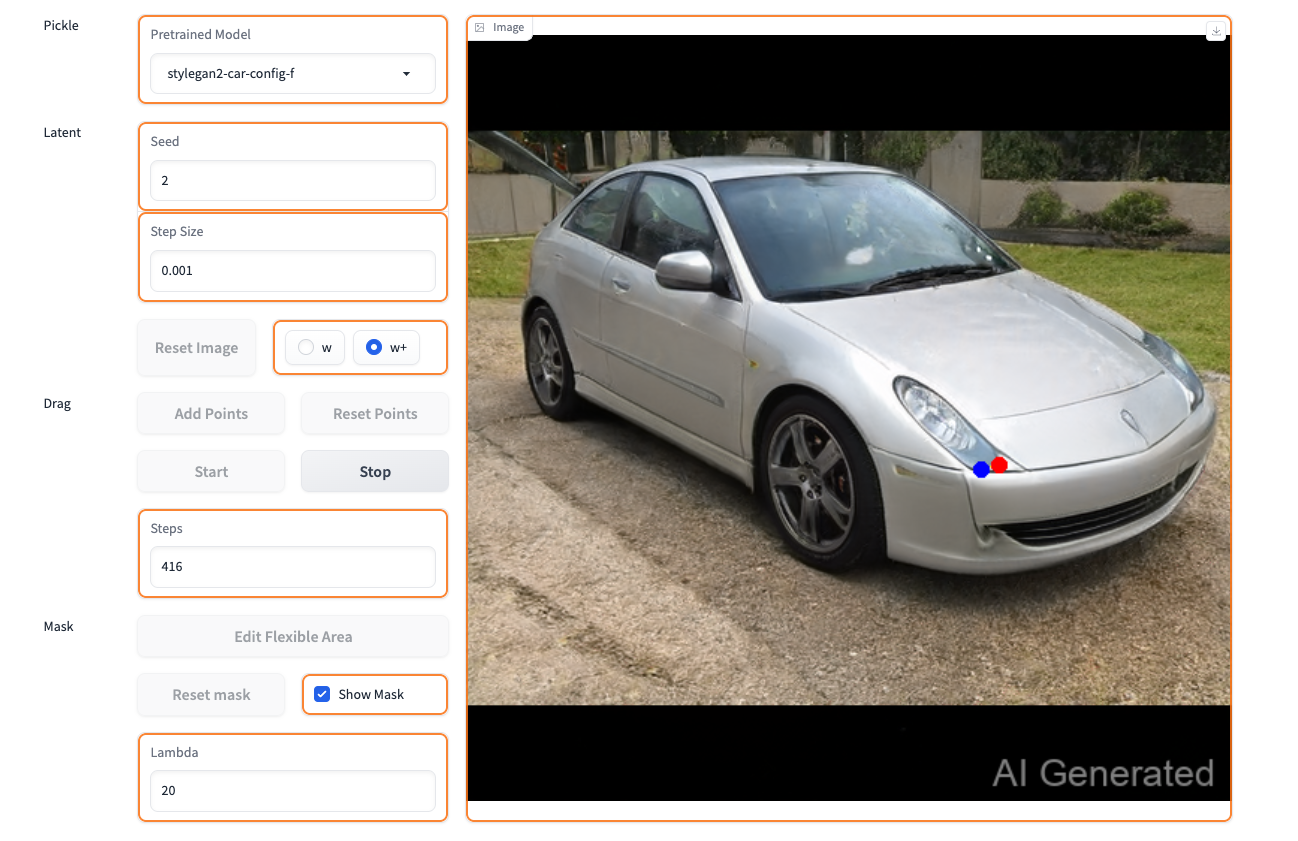

사용자 입력 초기 이미지 1차 최적화 단계 포인트 업데이트 최종 이미지 핸들 포인트 타겟 포인트

GAN 생성 이미지가 주어지면 사용자는 몇 개의 핸들 포인트(빨간 점), 타겟 포인트(파란 점) 및 편집 중인 이동 가능한 영역을 나타내는 마스크(밝은 영역)를 설정하기만 하면됩니다. 접근 방식은 반복적으로 이동 및 포인트 추적을 수행합니다. 이동 감독 단계에서 핸들 포인트(빨간 점)는 타겟 포인트(파란 점)로 이동하고 포인트 추적 단계에서 핸들 포인트는 이미지에서 객체를 추적하기 위해 업데이트됩니다. 이 과정은 핸들 포인트가 해당하는 타겟 포인트에 도달 할 때까지 계속됩니다.

핸들 포인트의 의미 있는 위치가 해당하는 타겟 포인트에 도달 할 때까지 우리는 사용자가 움직일 수있는 영역을 나타내는 이진 마스크 M을 선택적으로 그릴 수도 있습니다.

'👾 Deep Learning' 카테고리의 다른 글

| CM3leon(.Meta) (0) | 2023.07.16 |

|---|---|

| [CS324] Introduction (0) | 2023.07.03 |

| [RL] Stable-baselines3 gym -> gymnasium (0) | 2023.04.20 |

| Choose Your Weapon:Survival Strategies for Depressed AI Academics (0) | 2023.04.18 |

| [RL] Soft Actor-Critic (a.k.a SAC) (0) | 2023.04.12 |